Luật Trí tuệ nhân tạo trên thế giới và Việt Nam Bài 3: Xây dựng khung pháp lý cho trí tuệ nhân tạo cần cân bằng giữa đổi mới và quản trị rủi ro

Trí tuệ nhân tạo (AI) đang trở thành công nghệ nền tảng định hình mọi mặt đời sống kinh tế, xã hội và quản trị công. Nhiều quốc gia đã ban hành các đạo luật liên quan đến AI. Việt Nam cũng đang xây dựng dự Luật AI được xem là bước đi cần thiết để thống nhất khung pháp lý, điều phối giữa các bộ ngành, đồng thời nâng cao năng lực quản trị rủi ro, bảo vệ người dân…

Bối cảnh và xu hướng toàn cầu

Từ giữa năm 2024, thế giới chứng kiến một loạt động thái pháp lý quan trọng: Liên minh châu Âu thông qua Regulation (EU) 2024/1689, Đạo luật AI (EU AI Act); Hàn Quốc ban hành Đạo luật cơ bản về phát triển AI (Basic Act on the Development of AI) 2025; Hoa Kỳ ban hành Sắc lệnh hành pháp về AI an toàn, bảo mật và đáng tin cậy (Executive Order on Safe, Secure and Trustworthy AI) 2023.

Cùng thời điểm, Tổ chức Hợp tác và Phát triển kinh tế (OECD) cập nhật các nguyên tắc AI (AI Principles) (2019 - 2024) và Khung phân loại hệ thống AI (Framework for the Classification of AI Systems) 2022, tạo thành chuẩn mực toàn cầu về quản trị dựa trên rủi ro, minh bạch và trách nhiệm giải trình.

Điểm hội tụ của các khung này là hướng đến “AI có trách nhiệm” (Responsible AI) nhằm đảm bảo an toàn, nhân văn, minh bạch và khả năng kiểm soát của con người, đồng thời khuyến khích đổi mới sáng tạo. Từ nền tảng đạo đức (Ethical AI) đến quản trị rủi ro (risk management), các quốc gia đang chuyển từ “nguyên tắc tự nguyện” sang “cơ chế pháp lý ràng buộc” nhưng vẫn bảo đảm tính linh hoạt.

Với Việt Nam, Chiến lược quốc gia về Nghiên cứu, phát triển và ứng dụng AI đến năm 2030 được phê duyệt theo Quyết định 127/QĐ-TTg của Thủ tướng Chính phủ ngày 26/01/2021 mới chỉ xác định định hướng. Vì vậy, Luật AI là bước đi cần thiết để thống nhất khung pháp lý, điều phối giữa các bộ ngành, đồng thời nâng cao năng lực quản trị rủi ro, bảo vệ người dân và thúc đẩy doanh nghiệp tham gia chuỗi giá trị toàn cầu.

Nguyên tắc và định hướng lập pháp

Luật AI của Việt Nam nên được thiết kế trên 3 nguyên tắc nền tảng.

Quản lý dựa trên rủi ro (risk-based approach)

Mức độ can thiệp pháp lý cần tương xứng với rủi ro mà hệ thống AI gây ra cho con người, xã hội và môi trường. Đây là tinh thần cốt lõi của OECD Framework for Classification và EU AI Act, giúp luật vừa đủ sức bảo vệ quyền con người vừa không bóp nghẹt đổi mới.

Trung lập công nghệ (technology-neutral)

Luật chỉ nên điều chỉnh mục đích và cách sử dụng, không quy định theo công nghệ cụ thể. Với tốc độ tiến hóa nhanh của mô hình nền tảng (foundation models) và AI tạo sinh (Generative AI), nguyên tắc trung lập công nghệ giúp văn bản pháp luật không bị lỗi thời khi kỹ thuật thay đổi.

Luật khung, hướng dẫn linh hoạt (principle-based regulation)

Luật cần giữ vai trò định hướng, giao các chuẩn kỹ thuật, quy trình và hướng dẫn chi tiết cho cấp nghị định, thông tư và tiêu chuẩn quốc gia. Mô hình phân tầng này tương tự khung pháp lý của EU, Hàn Quốc, Singapore, giúp cân bằng giữa “tính ổn định của luật” và “tính thích ứng của công nghệ”.

Bên cạnh đó, Luật cần lồng ghép các giá trị đạo đức cốt lõi của Tổ chức Giáo dục, Khoa học và Văn hoá của Liên Hợp Quốc (UNESCO) (2021): công bằng, minh bạch, trách nhiệm, an toàn và tôn trọng quyền con người; cùng các nguyên tắc quản trị rủi ro của NIST AI RMF (2023): govern-map-measure-manage (Quản trị - ánh xạ - đo lường- quản lý).

Góp ý chính sách cụ thể cho dự thảo Luật AI

Phạm vi và đối tượng áp dụng

Dự thảo cần làm rõ nguyên tắc ngoại lãnh thổ (extraterritorial application). Nếu một hệ thống AI được phát triển ở nước ngoài nhưng có ảnh hưởng đáng kể đến thị trường, người dùng hoặc an ninh Việt Nam, vẫn phải chịu sự điều chỉnh của Luật. Thuật ngữ “ảnh hưởng đáng kể, có thể tiên liệu” nên được bổ sung vào Điều 2.

Phân loại rủi ro và cơ chế kiểm soát

Nên có phụ lục minh họa về các cấp độ rủi ro, tương tự Annex III của EU AI Act, với các tiêu chí định lượng như: mức độ tự chủ, quy mô người dùng, ảnh hưởng đến quyền cơ bản, hoặc lĩnh vực nhạy cảm (giáo dục, y tế, tư pháp, hạ tầng, việc làm).

Việc chuyển từ hậu kiểm sang tiền kiểm cần có ngưỡng định lượng rõ ràng, ví dụ khi mô hình thay đổi thuật toán, tăng quy mô người dùng, hoặc dữ liệu đào tạo vượt một ngưỡng cụ thể.

Nghĩa vụ đối với hệ thống rủi ro cao

Nguyên tắc “tương xứng” cần được đảm bảo: doanh nghiệp nhỏ và vừa (SME) có thể nộp hồ sơ kỹ thuật tối giản, dựa trên tài liệu sẵn có của nhà cung cấp mô hình đa dụng (GPAI providers). Điều này giúp giảm chi phí tuân thủ mà vẫn đảm bảo trách nhiệm giải trình.

Minh bạch và gắn nhãn nội dung do AI tạo

Các hệ thống tạo sinh (AIGC) phải tuân thủ cơ chế gắn nhãn và watermark nhằm xác định nguồn gốc nội dung. Luật nên tham chiếu các chuẩn C2PA (Coalition for Content Provenance and Authenticity) và ISO/IEC 42001 để đảm bảo khả năng tương thích quốc tế. Ngoài ra, cần yêu cầu công bố metadata về dữ liệu huấn luyện và mô hình để nâng cao minh bạch.

Đánh giá tác động AI trong khu vực công

Tất cả các dự án AI trong khu vực công cần thực hiện AI Impact Assessment (AIA) trước khi triển khai, với phần tóm tắt công khai.

Báo cáo AIA phải bao gồm: Mục tiêu sử dụng, đối tượng bị ảnh hưởng, nguồn dữ liệu, biện pháp giảm thiên lệch, và cơ chế khiếu nại. Cơ quan quản lý nên có quyền yêu cầu dừng triển khai khi hệ thống vượt ngưỡng rủi ro cho phép.

Thiết chế điều phối và thực thi

Luật nên thành lập Cơ quan điều phối quốc gia về AI (Vietnam AI Office) trực thuộc Chính phủ, có nhiệm vụ điều phối chính sách, quản lý rủi ro, và làm đầu mối hợp tác quốc tế. Thủ tướng là người chịu trách nhiệm chỉ đạo chung, còn các Bộ chuyên ngành ban hành quy định kỹ thuật chi tiết.

Cấu trúc văn bản và thứ bậc pháp lý

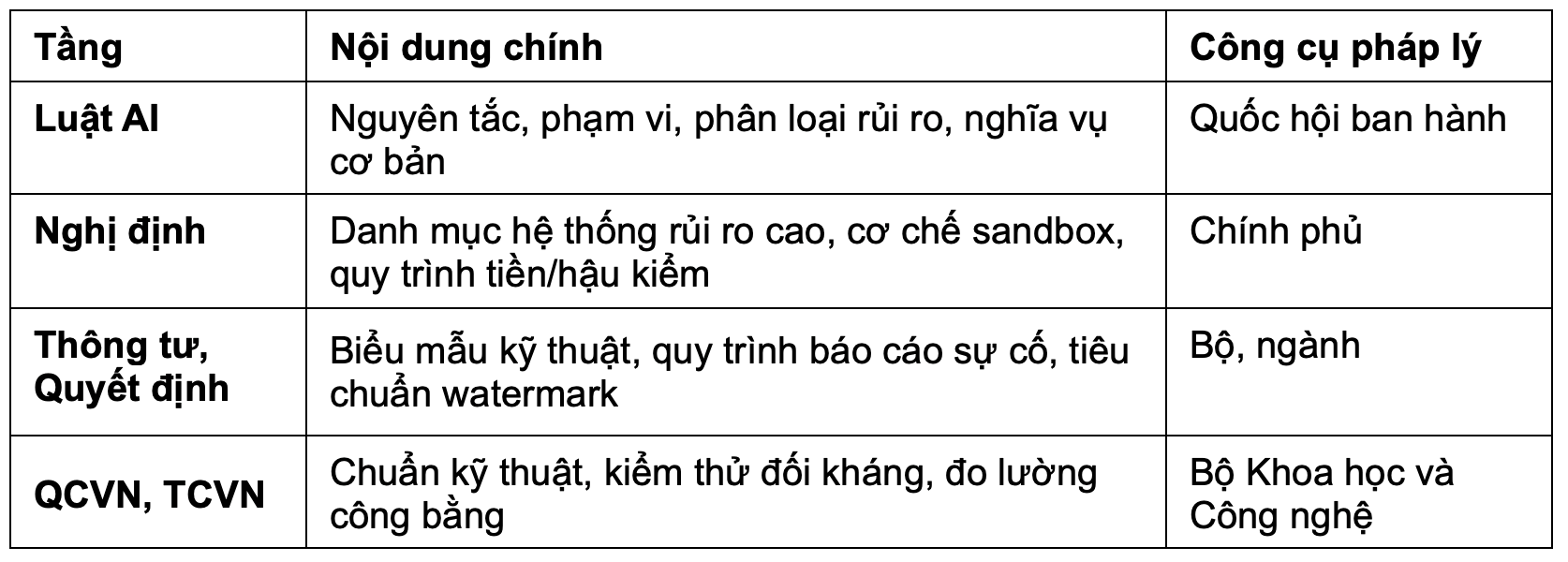

Cần duy trì cấu trúc nhiều tầng để đảm bảo tính khả thi và linh hoạt:

Cách tiếp cận này giúp Luật mang tính định hướng lâu dài, còn các văn bản dưới luật bảo đảm tính cập nhật khi công nghệ biến đổi nhanh chóng.

Kết luận và khuyến nghị

Luật Trí tuệ nhân tạo là nền móng để Việt Nam chủ động tham gia cuộc cách mạng AI một cách an toàn, minh bạch và bền vững. Đạo luật không chỉ bảo vệ người dân khỏi rủi ro của công nghệ mà còn tạo hành lang pháp lý cho sáng tạo và phát triển doanh nghiệp nội địa.

Để đạt mục tiêu này, cần triển khai lộ trình 3 giai đoạn:

Giai đoạn 1 (2025 - 2026): Ban hành Luật Khung về AI, thiết lập cơ quan điều phối quốc gia.

Giai đoạn 2 (2026 - 2027): Ban hành nghị định và sandbox thí điểm cho các lĩnh vực ưu tiên (y tế, giáo dục, tài chính, hành chính công).

Giai đoạn 3 (2027 - 2030): Chuẩn hóa kỹ thuật (ISO/IEC 42001, C2PA, NIST RMF), triển khai hệ thống đánh giá và chứng nhận AI có trách nhiệm.

Bài học từ OECD, EU và Hàn Quốc cho thấy đạo luật AI không chỉ là công cụ pháp lý, mà còn là công cụ định hướng văn hóa đổi mới trong đó Nhà nước, doanh nghiệp và xã hội cùng hợp tác để bảo đảm rằng sự phát triển của AI luôn phục vụ con người.

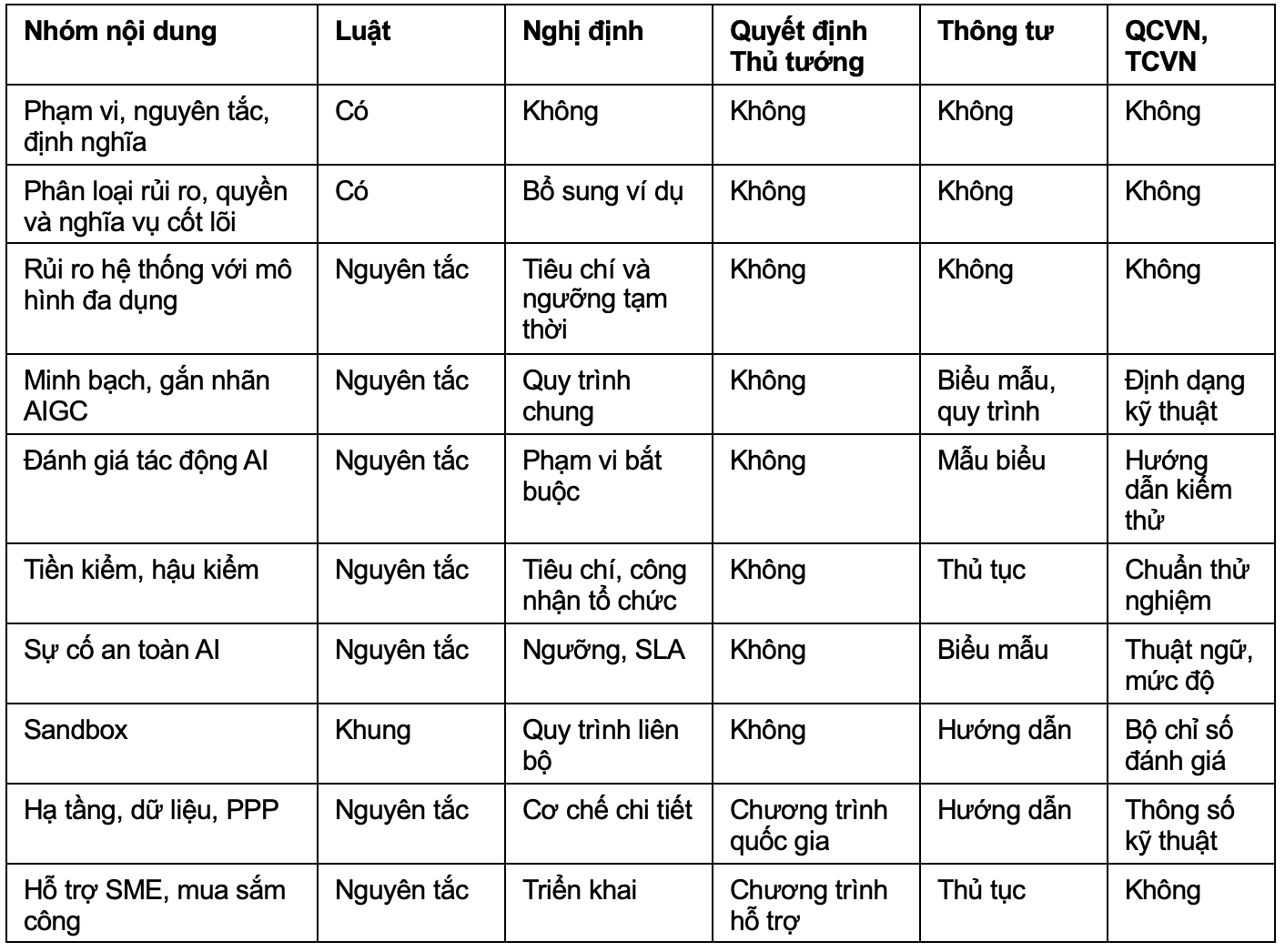

Phụ lục

Phụ lục A: Ma trận phân cấp văn bản

Phụ lục B, khung tối thiểu của đánh giá tác động AI

1. Mục tiêu sử dụng, đối tượng bị ảnh hưởng, chỉ số kết quả mong đợi.

2. Kiến trúc hệ thống, thành phần mô hình, luồng dữ liệu và quyền truy cập.

3. Nguồn dữ liệu, chất lượng dữ liệu, thiên lệch và biện pháp giảm thiểu.

4. An toàn, an ninh, kiểm thử đối kháng, quản lý lỗ hổng.

5. Công bằng và không phân biệt đối xử, phương án khắc phục.

6. Minh bạch, thông báo cho người dùng, gắn nhãn nội dung do AI tạo.

7. Quyền của cá nhân, cơ chế khiếu nại và xem xét bởi người thật.

8. Kế hoạch giám sát sau triển khai, tiêu chí tạm dừng, kế hoạch cải tiến.

9. Tác động môi trường, sử dụng năng lượng và phương án tối ưu hóa.

Tài liệu tham khảo

[1] OECD (2019, 2024). AI Principles & Framework for the Classification of AI Systems.

[2] European Commission (2024). Artificial Intelligence Act (Regulation (EU) 2024/1689).

[3] NIST (2023). Artificial Intelligence Risk Management Framework (AI RMF 1.0).

[4] UNESCO (2021). Recommendation on the Ethics of Artificial Intelligence.

[5] Republic of Korea (2025). Basic Act on the Development of Artificial Intelligence.

[6] ISO/IEC (2022). TR 24368:2022 - Responsible AI

Guidelines./.