Làm thế nào để kiểm soát rủi ro của các mô hình AI?

Các mô hình AI hiện nay vẫn tồn tại những lỗ hổng có thể dẫn đến nhiều rủi ro khó lường. Đã đến lúc các lập trình viên cần tư duy như những kỹ sư xây dựng, đặt an toàn và tính bền vững lên trên hết.

Các mô hình ngôn ngữ lớn (LLM) - nền tảng quan trọng trong sự phát triển của trí tuệ nhân tạo (AI) hiện nay - tồn tại một lỗ hổng bảo mật cố hữu, đó là không thể phân biệt rõ đâu là mã lệnh và đâu là dữ liệu.

Chính vì vậy, chúng dễ trở thành mục tiêu của hình thức tấn công gọi là “prompt injection”, hay còn gọi là tấn công chèn câu lệnh. Khi đó, mô hình có thể bị đánh lừa để thực hiện những yêu cầu mà lẽ ra không được phép.

Đôi khi, hậu quả chỉ dừng lại ở mức hài hước, nhưng trong nhiều trường hợp, thiệt hại có thể nghiêm trọng hơn rất nhiều.

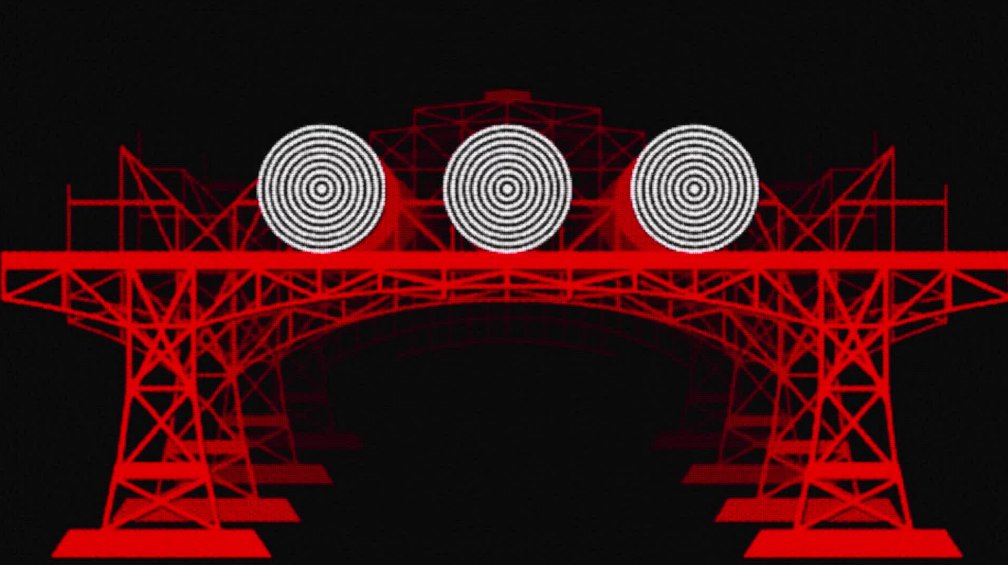

Nguy hiểm nhất là khi lỗ hổng này dẫn đến việc hình thành “bộ ba chết người”. Chẳng hạn, một công ty muốn tạo ra một trợ lý ảo hoàn hảo cho nhân viên nên đã trao cho LLM cùng lúc ba quyền: Truy cập vào dữ liệu không đáng tin cậy, đọc được thông tin mật và giao tiếp với thế giới bên ngoài. Khi ba yếu tố này kết hợp, rắc rối gần như là điều không thể tránh khỏi.

Việc phòng tránh không chỉ là trách nhiệm riêng của các kỹ sư AI. Người dùng thông thường cũng cần biết cách sử dụng AI an toàn, bởi chỉ một cấu hình sai trong ứng dụng cũng có thể vô tình kích hoạt “bộ ba chết người” này.

Tuy nhiên, một hệ thống AI được thiết kế tốt vẫn là điều cần thiết đầu tiên. Điều đó đồng nghĩa với việc các kỹ sư AI cần bắt đầu tư duy như những kỹ sư xây dựng.

Tuy nhiên, các nhà cung cấp dịch vụ bảo mật AI lại không nghĩ như vậy. Lập trình truyền thống vốn mang tính tất định: Một lỗi được phát hiện rồi sửa là xong. Cách nghĩ đó khiến nhiều lập trình viên tin rằng, chỉ cần thêm dữ liệu huấn luyện hoặc tinh chỉnh câu lệnh hệ thống là có thể khắc phục mọi vấn đề.

Họ quên rằng, AI hoạt động trong một thế giới mở, nơi dữ liệu và hành vi người dùng không bao giờ ổn định.

Các mô hình AI tiên tiến ngày nay thông minh hơn, có thể nhận diện và từ chối các yêu cầu độc hại hiệu quả hơn nhiều so với các phiên bản trước. Tuy nhiên, vẫn không thể loại bỏ hoàn toàn nguy cơ.

Không giống như hầu hết các phần mềm khác, các LLM hoạt động dựa trên xác suất. Đầu ra của chúng không phải là câu trả lời cố định, mà được tạo ra bằng cách lựa chọn ngẫu nhiên trong số những phản hồi có khả năng đúng cao nhất. Chính vì vậy, một cách tiếp cận an toàn mang tính tất định - tức là chỉ dựa vào quy tắc cố định - là chưa đủ để bảo vệ hệ thống.

Một hướng đi hợp lý hơn là học hỏi từ các kỹ sư trong thế giới thực: thay vì cố kiểm soát tuyệt đối, họ học cách làm việc cùng những hệ thống phức tạp và thất thường - những hệ thống mà không ai có thể đảm bảo sẽ luôn vận hành như mong đợi. Điều đó đồng nghĩa với việc phải chấp nhận sự không chắc chắn và chủ động xây dựng các lớp bảo vệ như biên độ an toàn, giới hạn rủi ro hay tỷ lệ sai sót cho phép.

“Xây dựng dư thừa” trong thời đại AI có thể hiểu là dùng một mô hình mạnh hơn mức cần thiết cho tác vụ, nhằm giảm nguy cơ bị đánh lừa để thực hiện hành vi không mong muốn.

Có thể là việc đặt giới hạn cho số lượng truy vấn mà mô hình được phép nhận từ các nguồn bên ngoài, tùy theo mức độ rủi ro. Các hệ thống AI cũng cần nguyên tắc, nếu buộc phải trao quyền truy cập vào thông tin mật, thì đừng bao giờ trao cho chúng chiếc “chìa khóa vạn năng”.

Trong thế giới vật chất, mọi cây cầu đều có giới hạn tải trọng - dù không phải lúc nào cũng được ghi rõ cho người lái xe biết. Điều quan trọng là những giới hạn đó luôn được đặt thấp hơn nhiều so với khả năng chịu đựng thực tế mà các phép tính cho thấy. Đã đến lúc thế giới ảo của các hệ thống AI cũng cần được trang bị những giới hạn tương tự./.