Claude Code, AI lai ghép và bước chuyển từ mô hình sang hệ thống

Bài viết phân tích trường hợp Claude Code như một dấu hiệu của sự chuyển dịch từ tư duy lấy mô hình làm trung tâm sang tư duy lấy hệ thống làm trung tâm. Trên cơ sở đó, thảo luận khả năng nổi lên của các kiến trúc trí tuệ nhân tạo (AI) lai ghép, trong đó sự kết hợp giữa mạng nơ ron, thành phần ký hiệu, kỹ nghệ phần mềm, tri thức miền và thiết kế thể chế sẽ ngày càng quan trọng.

Bài viết cũng nhấn mạnh nhu cầu tiếp cận AI theo tinh thần liên ngành, coi đây không chỉ là đối tượng của kỹ thuật, mà còn là vấn đề của tâm lý học, kinh tế học, xã hội học, luật học và quản trị chiến lược. Từ đó, một số hàm ý cho hệ sinh thái AI tại Việt Nam được gợi ra.

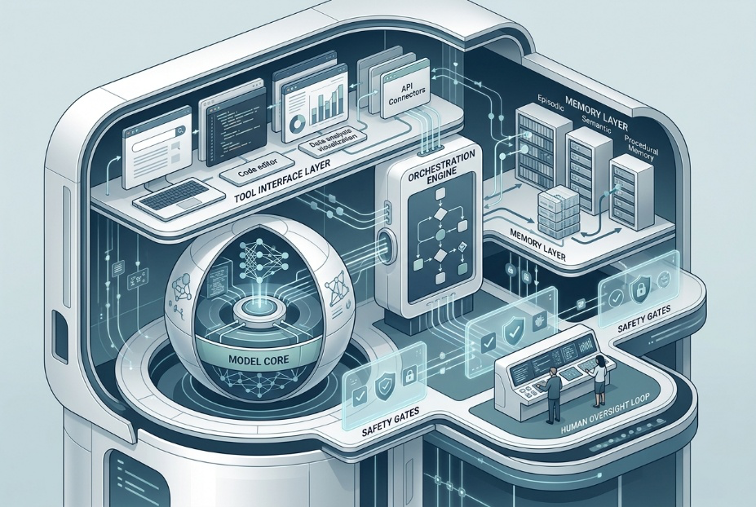

Sự xuất hiện của các hệ thống như Claude Code đang gợi mở một dịch chuyển quan trọng trong quỹ đạo phát triển của AI. Nếu trong giai đoạn đầu của làn sóng mô hình ngôn ngữ lớn (LLMs), trọng tâm chú ý gần như dồn cả vào quy mô mô hình, dữ liệu huấn luyện và khả năng sinh ngôn ngữ, thì thực tiễn triển khai gần đây cho thấy năng lực hữu dụng và mức độ tin cậy của AI ngày càng phụ thuộc vào kiến trúc hệ thống (system architecture) bao quanh mô hình, bao gồm vòng lặp tác tử (agent loop), công cụ (tools), lớp điều phối (orchestration), cổng kiểm soát công cụ (tool gate), bộ nhớ (memory), cơ chế phân quyền, giám sát và phản hồi.

Có những thời điểm trong lịch sử công nghệ mà một sản phẩm cụ thể, tự thân nó, chưa chắc đã là đích đến cuối cùng, nhưng lại có giá trị như một cánh chim báo mùa. Theo nghĩa đó, Claude Code đáng để được đọc như một tín hiệu lớn hơn chính nó.

Từ mô hình ngôn ngữ lớn đến kiến trúc hệ thống

Nếu nhìn lại giai đoạn đầu của làn sóng LLM, ta sẽ thấy phần lớn cuộc tranh luận xoay quanh quy mô, benchmark và hiệu suất sinh ngôn ngữ. Đó là một giai đoạn tất yếu, bởi khi một năng lực mới xuất hiện đủ mạnh, ánh mắt con người thường bị hút vào chính trung tâm phát sáng của nó. Nhưng cũng như trong thần thoại Hy Lạp, nơi Prometheus đem lửa về cho loài người, ánh sáng ban đầu luôn mê hoặc đến mức khiến ta quên mất câu hỏi khó hơn, làm thế nào để dùng ngọn lửa ấy mà không thiêu rụi ngôi nhà của mình.

Trong thực tiễn triển khai AI, đặc biệt với các hệ thống có khả năng hành động, càng ngày càng rõ rằng mô hình mạnh là điều kiện cần, nhưng không còn là điều kiện đủ. Một mô hình có thể sinh ra câu trả lời mạch lạc, tỏ ra thông minh trong nhiều tình huống, nhưng nếu nó không được đặt trong một cấu trúc thực thi có kỷ luật thì mức độ tin cậy sẽ nhanh chóng giảm sút khi nhiệm vụ trở nên nhiều bước, có trạng thái, có quyền hạn và có hệ quả. Chính ở đây, lớp giàn giáo hệ thống xuất hiện như phần không thể thiếu [1-5]. Nó bao gồm vòng lặp tác tử, cơ chế gọi công cụ, kiểm tra điều kiện, phân nhánh hành động, quản trị lỗi, quản trị chi phí, quản trị quyền truy cập và đôi khi là cả những lớp đánh giá trung gian trước khi hành động tiếp tục.

Nói ngắn gọn, giá trị đang dịch chuyển từ chỗ chỉ nằm trong bộ não sang chỗ nằm trong cả cơ thể và hệ thần kinh của hệ thống. Một mô hình rất mạnh nhưng bị đặt trong một kiến trúc sơ sài cũng giống một học giả bị ném vào chiến trường mà không có bản đồ, không có quân lệnh và không có hậu cần. Ngược lại, một kiến trúc điều phối tinh vi nhưng lõi mô hình quá yếu thì chỉ như một guồng máy quan liêu vận hành rườm rà mà không có trí tuệ thực chất. Vì thế, đổi mới quan trọng nhất hiện nay không còn nên được mô tả bằng một đối lập giản đơn giữa mở rộng quy mô (scaling) và không scaling, mà bằng sự đồng thiết kế giữa mô hình và hệ thống.

Claude Code như một tín hiệu của trí tuệ nhân tạo được kiến trúc hóa

Tôi tiếp cận cuộc tranh luận quanh Claude Code không chỉ từ bình diện quan sát bên ngoài. Trong thời gian qua, tôi đã nghiên cứu khá kỹ bộ bản đồ nguồn (source) map bị lộ của Claude Code (*), dùng bộ Uncle Dao Reverse Engineering Suite để bóc tách, đối chiếu và phân tích nhiều lớp hành vi vận hành của hệ thống. Từ quá trình đó, tôi dựng ra các báo cáo riêng về vòng lặp tác tử, các lớp cổng kiểm soát công cụ, cờ tính năng, nhánh điều kiện và một số hành vi thiết kế bị ẩn đi ở bề mặt trải nghiệm người dùng.

Tôi cũng đã thử kích hoạt và dựng thử một số tính năng vốn đang bị khóa hoặc bị tắt, kể cả các đoạn logic gắn với những điều kiện loại người dùng như USER_TYPE == ant, để quan sát cách hệ thống phản ứng khi kiến trúc vận hành được đẩy sang một trạng thái khác.

Tôi nói điều này với mong muốn nhấn mạnh những nhận định ở đây không chỉ dựa trên các bình luận thứ cấp đang lan truyền trên mạng. Chúng đi ra từ đọc mã, từ phân tích ngược (reverse engineering), từ đối chiếu kiến trúc và từ thực nghiệm. Và càng đi sâu, tôi càng tin Claude Code quan trọng không phải vì nó là một mô hình tốt hơn theo nghĩa thuần túy, mà vì nó là một biểu hiện rõ hơn của một xu hướng, AI hữu dụng đang trở thành AI được kiến trúc hóa [1, 2].

Điều đáng chú ý là xu hướng này không chỉ hiện ra trong một tệp (file) mã hay một vụ lộ bàn đồ nguồn (source map). Ngay cả khi nhìn vào hướng phát triển sản phẩm mới hơn như Managed Agents của Anthropic, ta cũng thấy cùng một logic lặp lại.

Chính Anthropic mô tả hướng này như một dạng siêu giàn giáo (meta harness), nơi mục tiêu không còn chỉ là làm cho mô hình trả lời hay hơn, mà là xây cả một lớp hạ tầng quản trị quanh mô hình, để nó có thể được phân quyền, điều phối, theo dõi, giới hạn, gắn công cụ, kết nối nhiều môi trường thực thi và vận hành ổn định trong những quy trình thực. Điều đó củng cố thêm cho nhận định rằng tương lai của AI sẽ khó được quyết định chỉ bằng mô hình, mà bằng khả năng thiết kế toàn bộ kiến trúc bao quanh mô hình [2].

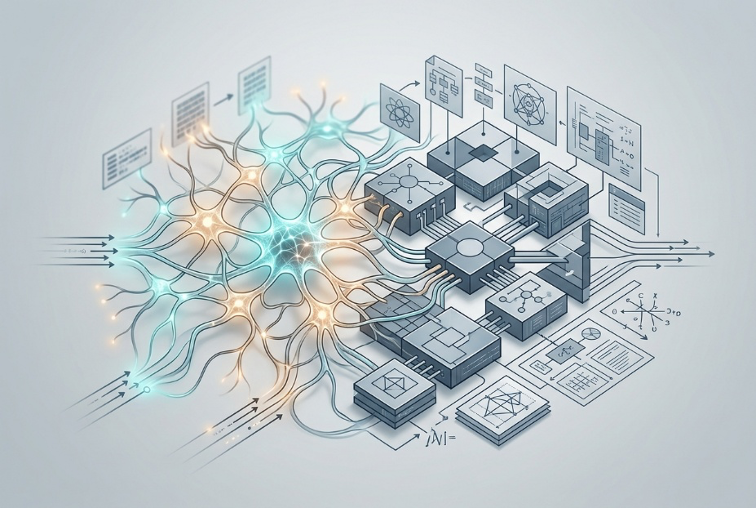

Trí tuệ nhân tạo thần kinh biểu tượng và câu hỏi về một con đường lai ghép

Một trong những tranh luận thú vị được khơi lên từ trường hợp Claude Code là câu hỏi liệu chúng ta có đang chứng kiến sự trở lại của AI thần kinh biểu tượng (neurosymbolic AI) hay không. Tôi cho rằng đây là một câu hỏi đáng đặt ra, nhưng cần đi với sự phân biệt khái niệm đủ chặt. Không phải mọi nhánh điều kiện, mọi vòng lặp xác định hay mọi logic công cụ nằm quanh một LLMs đều tự động cấu thành một hệ AI thần kinh biểu tượng theo nghĩa học thuật mạnh. Tuy nhiên, cũng không thể phủ nhận thực tiễn phát triển AI đang ngày càng cho thấy sự cần thiết của những thành phần không thuần xác suất [1, 2].

Ở đây, tôi thấy Gary Fred Marcus, nhà tâm lý học và nhà khoa học nhận thức người Hoa Kỳ, có một trực giác đáng chú ý khi ông xem Claude Code như một biểu hiện của nhu cầu quay trở lại với những nguyên lý mà AI cổ điển từng theo đuổi, đặc biệt là nhu cầu về cấu trúc, về tính xác định tương đối, và về các lớp lý luận được tổ chức rõ ràng hơn. Tôi không hoàn toàn đồng nhất với mọi khẳng định mạnh của Gary Marcus, nhưng tôi tôn trọng cách ông luôn buộc cuộc tranh luận AI phải trở về với những câu hỏi nền tảng của nhận thức, chứ không chỉ dừng ở mức trình diễn năng lực bề mặt.

Từ một hướng khác, trong những cuộc trao đổi trước đây, tôi từng nghe GS. Dương Nguyên Vũ, Phó Hiệu trưởng VinUni, một nhà khoa học đã theo đuổi AI hơn 30 năm, chia sẻ về khả năng kết hợp giữa kiến trúc Transformer hiện nay với các hướng tiếp cận thần kinh biểu tượng. Tôi ghi nhớ điều đó không phải vì nó là một tiên đoán hào nhoáng, mà vì nó giống một dạng trực giác khoa học lắng đọng, xuất phát từ việc đã quan sát đủ lâu những chu kỳ lên xuống của công nghệ. Càng theo dõi các hệ thống hiện tại, tôi càng thấy trực giác ấy có lý.

Có thể AI tương lai sẽ không quay lại symbolic AI theo nghĩa nguyên xi của nhiều thập niên trước, nhưng cũng ngày càng khó tin rằng chỉ một lớp học thống kê thuần túy là đủ để đưa hệ thống tới mức tin cậy mà xã hội cần. Trên thực tế, các hệ thống như AlphaGeometry đã cho thấy một dạng kết hợp chặt hơn giữa học máy và suy luận biểu tượng, gợi ý rằng hướng lai ghép không chỉ là một trực giác lý thuyết, mà đã có những biểu hiện thực chứng ở biên công nghệ hiện nay [4].

Tất nhiên, tương lai công nghệ luôn khó đoán. Không ai có quyền nói một cách quả quyết con đường nào chắc chắn sẽ thắng trong 10 năm tới. Nhưng đây chính là nơi năng lực của một nhà chiến lược công nghệ được thử lửa. Người chiến lược không chỉ nhìn vào dữ kiện đã khép lại, mà còn phải đọc những tín hiệu yếu, ghép những mảnh chuyển động tưởng như rời rạc và hình thành một trực giác đủ mạnh để định hướng hành động sớm hơn đám đông. Trực giác đó không phải lời tiên tri theo nghĩa thần bí. Nó là kết quả của quan sát, đối chiếu, trải nghiệm, suy ngẫm và cả dũng khí chấp nhận có những quyết định phải được đưa ra trước khi bằng chứng tuyệt đối xuất hiện.

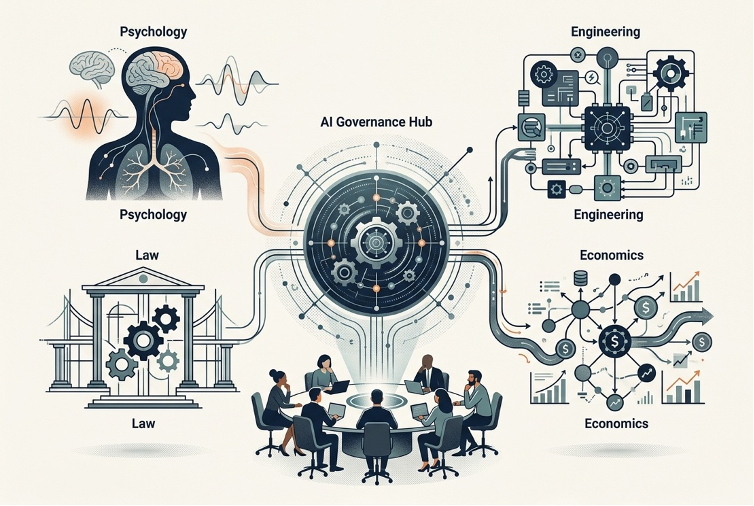

Vì sao trí tuệ nhân tạo phải được nhìn như một đối tượng liên ngành

Một trong những điều tôi luôn thấy thiếu trong các cuộc tranh luận về AI ở Việt Nam là sự áp đảo quá lớn của tiếng nói kỹ thuật. Dĩ nhiên, kỹ sư, nhà nghiên cứu máy học và lập trình viên giữ vai trò trung tâm trong việc xây dựng hệ thống. Nhưng nếu chỉ để những người làm kỹ thuật nói chuyện với nhau về AI, chúng ta sẽ có nguy cơ hiểu rất rõ cái máy mà lại hiểu không đủ về đời sống mà cái máy ấy sẽ tác động vào.

AI ngày nay đã chen vào giáo dục, truyền thông, sức khỏe tinh thần, tài chính, pháp luật, lao động, sáng tạo, tổ chức và cả cấu trúc chú ý của con người. Vì vậy, nó là đối tượng liên ngành ngay trong bản chất. Tôi nhiều lần nghĩ tới những trao đổi với người bạn của tôi, Lê Nguyên Phương, một nhà tâm lý học có nhiều suy tư sâu sắc về con người, hành vi và xã hội. Những góc nhìn như vậy rất quan trọng, bởi AI không chỉ làm thay đổi năng suất lao động, mà còn làm biến đổi kỳ vọng, cảm xúc, nỗi sợ, động cơ và cách con người hiểu chính mình. Bỏ qua tâm lý học là bỏ qua một phần rất lớn của tác động AI.

Tương tự, những trao đổi với người bạn của tôi, Trần Sĩ Chương, một nhà kinh tế học nhiều suy tư về giáo dục, sự học, vốn con người và năng lực thích nghi, cũng nhắc tôi rằng AI rốt cuộc không chỉ là chuyện công nghệ làm được gì. Nó còn là chuyện một xã hội chuẩn bị con người của mình như thế nào trước sự tái cấu trúc của công việc, tri thức và năng lực phán đoán. Nếu chỉ bàn về AI bằng ngôn ngữ kỹ thuật, ta dễ thấy những chức năng mới, nhưng khó nhìn đủ những biến đổi sâu hơn trong cấu trúc kinh tế, giáo dục và hành vi xã hội.

Có lẽ vì thế mà tiếp cận AI trong giai đoạn mới cần một vòng tròn rộng hơn, trong đó kỹ thuật, tâm lý học, kinh tế học, xã hội học, luật học, quản trị chiến lược và triết học cùng tham dự. Chỉ khi đó, chúng ta mới tránh được hai cực đoan, hoặc thần tượng hóa công nghệ như một sức mạnh tự cứu rỗi, hoặc sợ hãi công nghệ như một tai họa tất yếu. Thái độ đúng hơn, theo tôi, là nhìn AI như một hiện tượng vừa kỹ thuật vừa nhân văn, vừa vật chất vừa thể chế, vừa tính toán vừa đạo đức.

Hàm ý cho chiến lược trí tuệ nhân tạo của Việt Nam

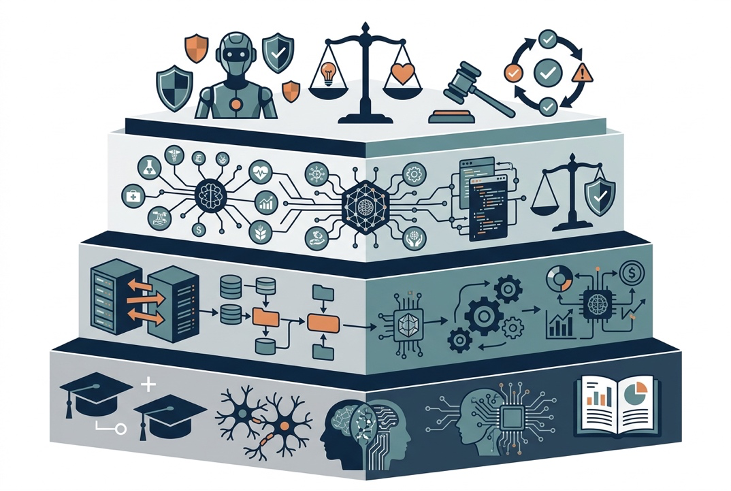

Nếu chấp nhận rằng AI đang dịch chuyển từ mô hình sang hệ thống, và từ công nghệ đơn ngành sang hiện tượng liên ngành, thì chiến lược AI của Việt Nam cũng cần được điều chỉnh tương ứng. Điều đầu tiên cần tránh là một ảo tưởng tốn kém, rằng năng lực quốc gia trong AI chỉ có thể được đo bằng khả năng sở hữu mô hình lớn nhất hoặc hạ tầng tính toán mạnh nhất. Đó là một cuộc chơi mà không nhiều nền kinh tế có thể theo đuổi đến cùng. Nhưng nếu nhìn AI như một bài toán kiến trúc hệ thống (system architecture), một bài toán tích hợp tri thức miền (domain integration), một bài toán xây dựng lớp giàn giáo vận hành (operational harness) đủ an toàn và một bài toán thiết kế thể chế (institutional design), thì dư địa hành động của Việt Nam trở nên rộng hơn nhiều.

Nhìn rộng hơn, đây không còn là câu chuyện của từng công ty riêng lẻ. Nó gắn với cuộc đua AI Hoa Kỳ và Trung Quốc (U.S - China AI competition), vốn ngày càng định hình cục diện công nghệ toàn cầu. Hoa Kỳ hiện vẫn dẫn đầu về số lượng mô hình hàng đầu và quy mô đầu tư tư nhân, trong khi Trung Quốc đang thu hẹp khoảng cách về hiệu năng mô hình, đồng thời duy trì ưu thế về công bố khoa học, bằng sáng chế và đặc biệt là cách tiếp cận mở, triển khai rộng trong sản xuất, robot và các ngành công nghiệp vật lý [6]. Nếu Hoa Kỳ có xu hướng tập trung nhiều vào biên công nghệ và hạ tầng tính toán, thì Trung Quốc đang cho thấy một con đường khác, kết hợp mô hình mở, chi phí thấp hơn, triển khai quy mô lớn hơn và tạo ra các vòng phản hồi dữ liệu từ nền kinh tế thực [6]. Với Việt Nam, điều cần học không phải là sao chép nguyên xi một bên nào, mà là nhận ra rằng AI giờ đây vừa là công nghệ, vừa là năng lực công nghiệp, vừa là chiến lược quốc gia.

Theo tôi, Việt Nam cần chú trọng đồng thời bốn tầng:

Tầng thứ nhất là đào tạo và phát triển nguồn nhân lực AI theo hướng liên ngành (interdisciplinary talent development), nơi kỹ sư không phải người duy nhất có tiếng nói.

Tầng thứ hai là thúc đẩy doanh nghiệp xây các hệ thống AI lai ghép (hybrid AI systems) gắn với bài toán thật, dữ liệu thật và quy trình thật, thay vì bị ám ảnh bởi việc phải tự huấn luyện mọi thứ từ đầu.

Tầng thứ ba là định vị lại nghiên cứu học thuật, để những hướng giao thoa giữa LLMs, tri thức miền, suy luận (reasoning), kỹ nghệ phần mềm và quản trị rủi ro được coi trọng hơn. Tầng thứ tư là chuẩn bị khung đánh giá và quản trị cho AI tác tử (agentic AI), bởi khi hệ thống không còn chỉ trả lời mà đã có thể hành động, trách nhiệm pháp lý, trách nhiệm đạo đức và thiết kế kiểm soát phải được đặt ra ở một cấp độ mới.

Nói cách khác, Việt Nam không nhất thiết phải là nơi có mô hình lớn nhất để vẫn có thể trở thành nơi ứng dụng AI một cách khôn ngoan, hiệu quả và có trách nhiệm. Trong bối cảnh hiện nay, đó có thể là con đường thực tế hơn, và cũng có khả năng tạo ra lợi ích xã hội rõ ràng hơn.

*

* *

Claude Code, theo cách tôi nhìn, không phải bằng chứng cuối cùng rằng một trường phái lý thuyết nào đó đã chiến thắng dứt điểm. Nhưng nó là một chỉ dấu quan trọng cho thấy kỷ nguyên hậu LLMs có lẽ sẽ không thuộc về mô hình đơn độc. Nó sẽ thuộc về những hệ thống biết kết hợp nhiều lớp năng lực khác nhau, trong đó mô hình nơ ron, thành phần ký hiệu, công cụ, bộ nhớ, cơ chế điều phối, kỹ nghệ phần mềm và thiết kế thể chế cùng góp phần tạo nên tính hữu dụng và tính đáng tin cậy.

Nếu phải chốt lại bằng một mệnh đề ngắn, tôi sẽ nói thế này. Claude Code không chứng minh rằng LLMs đã đủ. Nó chứng minh điều ngược lại, rằng để AI thật sự hữu dụng, mô hình mạnh vẫn chưa đủ. Điều chúng ta cần là một kiến trúc rộng hơn, chặt hơn, trưởng thành hơn, và cuối cùng, nhân văn hơn.

Ngày 31/3/2026, cộng đồng công nghệ quốc tế chú ý tới một sự cố hiếm gặp, khi mã nguồn phía khách của Claude Code bị lộ gián tiếp thông qua một tệp ánh xạ mã nguồn (source map) được đóng gói nhầm trong gói công khai trên npm. Sự kiện này không chỉ làm dấy lên các lo ngại về an toàn chuỗi cung ứng phần mềm (software supply chain security), mà còn vô tình mở ra một cơ hội hiếm hoi để giới nghiên cứu, giới an ninh mạng và cộng đồng phát triển phần mềm nhìn rõ hơn phần giàn giáo hệ thống (system harness) đứng phía sau một tác tử AI thương mại hàng đầu. Vì lý do đó, Claude Code đáng được xem không chỉ như một sản phẩm, mà như một trường hợp nghiên cứu (case study) đặc biệt của AI được kiến trúc hóa [7].

Tài liệu tham khảo

[1] Anthropic Engineering (2025), Effective Harnesses for Long-Running Agents, https://www.anthropic.com/engineering/ effective-harnesses-for-long-running-agents, accessed 10 April 2026.

[2] T.R. Besold, A.A. Garcez, S. Bader, et al. (2017), Neural-Symbolic Learning and Reasoning: A Survey and Interpretation, 58pp, DOI: 10.48550/arXiv.1711.03902.

[3] A.A. Garcez, L.C. Lamb (2023), “Neurosymbolic AI: The 3rd Wave”, Artificial Intelligence Review, 56, pp.12387-12406.

[4] Google DeepMind (2024), AlphaGeometry: An Olympiad-Level AI System for Geometry,

https://deepmind.google/blog/alphageometry-an-olympiad-level-ai-system-for-geometry/, accessed 10 April 2026.

[5] Anthropic Engineering (2026), Scaling Managed Agents: Decoupling the Brain from the Hands, https://www.anthropic. com/engineering/managed-agents, accessed 12 March 2026.

[6] Stanford Institute for Human-Centered Artificial Intelligence (2025), AI Index Report 2025, https://jpt.spe.org/twa/stanford-ai-index-2025-rapid-ai-growth-investment-surge-and-global-challenges, accessed 10 March 2026.

[7] Zscaler ThreatLabz (2026), Anthropic Claude Code Leak: Security Analysis of the Exposed Source Map Incident, https://www.zscaler.com/blogs/security-research/anthropic-claude-code-leak, accessed 10 March 2026./.